Nvidia sceglie i processori AMD, Intel può solo restare a guardare

Nvidia sceglie i processori AMD al posto degli Intel Xeon

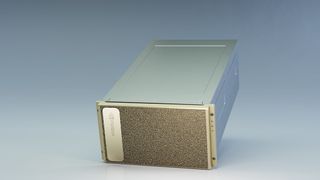

Qualche giorno fa Nvidia ha fatto un annuncio scocciante, quando ha rivelato di voler interrompere una collaborazione decennale con Intel. Nel prossimo futuro, Nvidia infatti usare i processori AMD EPYC nei suoi sistemi DGC A100 dedicati al deep learning. Escono di scena, dunque, i processori Intel Xeon.

Charlie Boyle, Vice Presidente e General Manager DGX Systemas presso Nvidia, ha spiegato le ragioni di tale scelta:

"Affinché la GPU abbia sempre dati da elaborare, ci serve una CPU veloce con quanti più core e linee PCI possibile. I processori AMD che abbiamo scelto hanno 64 core ciascuno, molte linee PCI e supporto per il protocollo PCIe Gen4".

- I migliori servizi di web hosting Linux del 2020

- I migliori software per il remote desktop

- Le migliori distribuzioni Linux

Intel dovrebbe aggiungere il PCIe 4.0 in futuro, insieme ai processori per server Ice Lake, prodotti a 10 nanometri. Per il momento, tuttavia, l'azienda di Santa Clara può solo guardare mentre AMD le sfila di mano il mercato. I processori EPYC offrono anche supporto per memoria eight-channel, cioè due canali in più rispetto a ciò che si trova sugli Xeon di Intel.

L'AMD EPYC 7742 ha più core (64 contro i 56 dell'Intel Xeon Platinum 9282), molta più cache (256MB Vs 77MB), un TDP più basso (225W Vs 400W) e un costo decisamente più ridotto ($6,950 vs circa $25,000).

Tutti vantaggi dovuti al processo produttivo a 7 nm, grazie a cui AMD può inserire più transistori in un die dalle stesse dimensioni, e ottimizzare di conseguenza il consumo energetico e le frequenze.

Con il tempo, scopriremo se questa scelta cambierà le relazioni tra Nvidia e AMD a lungo termine, oppure se si tratta solo di una tregua effimera.

Sei un professionista? Iscriviti alla nostra Newsletter

Iscriviti alla newsletter di Techradar Pro per ricevere tutte le ultime notizie, opinioni, editoriali e guide per il successo della tua impresa!

- Here's our list of the best dedicated server hosting on the market

Désiré has been musing and writing about technology during a career spanning four decades. He dabbled in website builders and web hosting when DHTML and frames were in vogue and started narrating about the impact of technology on society just before the start of the Y2K hysteria at the turn of the last millennium.