Las 7 novedades de IA más importantes de la Google I/O 2024 – desde Gemini al Project Astra

Gemini, Gemini, y más Gemini

La keynote de la Google I/O 2024 fue un festival con Gemini por todas partes, y el CEO Sundar Pichai acertó al describirla como la "Era Gemini".

Toda la keynote giró en torno a Gemini y la IA; de hecho, Google dijo esto último 121 veces. Desde la presentación de un futurista asistente de inteligencia artificial llamado "Project Astra" (Proyecto Astra) que puede funcionar en un teléfono (y quizá en unas gafas algún día), hasta la incorporación de Gemini a casi todos los servicios o productos que ofrece la empresa, la inteligencia artificial fue sin duda el tema principal.

Todo fue suficiente para derretir la mente de todos, así que hemos desglosado las 7 cosas más importantes que Google desveló y habló durante su keynote principal de la Google /O 2024.

1. Google anunció el Project Astra: un "agente de IA" para la vida cotidiana

Resulta que Google tiene una respuesta al GPT-4o de OpenAI y al CoPilot de Microsoft. Project Astra, al que denominan un "agente de IA" para la vida cotidiana, es básicamente como un Google Lens mejorado y parece realmente impresionante, capaz de entender, razonar y responder a vídeo y audio en tiempo real.

En un vídeo grabado con un teléfono Pixel, se veía al usuario caminando por una oficina, proporcionando una imagen en directo de la cámara trasera y haciendo preguntas a Astra de improviso. Gemini veía y entendía los elementos visuales al tiempo que respondía a las preguntas.

Esto habla del contexto multimodal y largo en el backend de Gemini, que trabaja de forma impecable para identificar y dar una respuesta rápidamente. En la demostración, sabía cuál era la parte específica de un altavoz e incluso podía identificar un barrio de Londres. También es generativo, porque creó rápidamente el nombre de un grupo musical para un simpático cachorro junto a un peluche (ver el vídeo de arriba).

No se lanzará inmediatamente, pero los desarrolladores y la prensa, como nosotros en TechRadar, vamos a poder probarlo. Y aunque Google no lo aclaró, hubo un avance de las gafas para Astra, lo que podría significar que las Google Glass podrían volver.

Get the best Black Friday deals direct to your inbox, plus news, reviews, and more.

Sign up to be the first to know about unmissable Black Friday deals on top tech, plus get all your favorite TechRadar content.

Aún así, incluso como demo durante la Google I/O, es realmente impresionante y potencialmente muy convincente. Podría potenciar los móviles y los actuales asistentes de Google e incluso de Apple. Además, también muestra las verdaderas ambiciones de Google en cuanto a IA, una herramienta que puede ser inmensamente útil y fácil de usar.

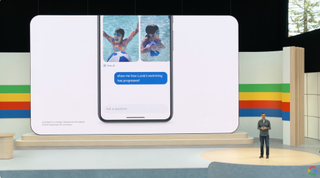

2. Google Fotos ha recibido un útil impulso de IA gracias a Gemini

¿Alguna vez has querido encontrar rápidamente una foto específica que capturaste en algún momento del pasado lejano? Tal vez sea una nota de un ser querido, una foto temprana de un perro cuando era cachorro o incluso tu matrícula. Pues bien, Google está haciendo realidad ese deseo con una importante actualización de Google Fotos que lo fusiona con Gemini. Esto le da acceso a tu biblioteca, le permite buscar en ella y te ofrece fácilmente el resultado que buscas.

En una demostración en el escenario, Sundar Pichai reveló que puedes pedirle tu matrícula y Fotos te mostrará una imagen con ella y los dígitos/caracteres que la componen. Del mismo modo, puedes pedir fotos de cuando tu hijo aprendió a nadar, junto con otros detalles. Esto debería facilitar la búsqueda incluso en las fototecas más desorganizadas.

Google ha bautizado esta función como "Ask Photos" ("Pregúntale a Fotos" y la pondrá a disposición de todos los usuarios en las "próximas semanas". Y es casi seguro que será muy útil, y hará que la gente que no utiliza Google Fotos se ponga un poco celosa.

Cabe señalar que la aplicación de Google Fotos ya te permite buscar fotos basándose en un término de búsqueda que escribas, pero con la nueva versión buscará mucho mejor. Queda por ver si, al igual que pasa ahora, solo funcionará con las fotos subidas a la nube de Google Fotos (probablemente sí).

3. Los deberes de tus hijos ahora serán muchos más fáciles gracias a NotebookLM

Todos los padres con hijos en época escolar conocerán el horror que supone intentar ayudar a los niños con los deberes; si alguna vez supiste de estas cosas en el pasado, lo más probable es que tras tantos años se te haya olvidado. Pero Google puede haber hecho la tarea mucho más fácil, gracias a una actualización de su aplicación para tomar notas NotebookLM (que de momento solo está disponible en EEUU).

NotebookLM ya tiene acceso a Gemini 1.5 Pro y, según la demostración realizada en la Google I/O 2024, ahora será mejor profesor que nunca. La demostración mostraba a Josh Woodward, de Google, cargando un cuaderno lleno de notas sobre un tema de aprendizaje, en este caso, la ciencia. Con sólo pulsar un botón, era capaz de crear una guía de aprendizaje detallada, con otros resultados como cuestionarios y preguntas frecuentes, todo ello extraído del material original.

Impresionante, pero estaba a punto de ser mucho mejor. Una nueva función, que por ahora sigue siendo un prototipo, era capaz de emitir todo el contenido como audio, creando así un debate al estilo podcast. Y lo que es más, el audio incluía a más de un interlocutor, que charlaba sobre el tema con naturalidad de una forma que sin duda sería más útil que un padre frustrado intentando hacer de profesor.

Woodward pudo incluso interrumpir y hacer una pregunta, en este caso "danos un ejemplo de baloncesto», momento en el que la IA cambió de táctica y propuso metáforas ingeniosas sobre el tema, pero en un contexto accesible.

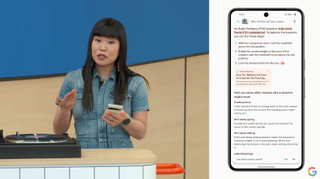

4. Pronto serás capaz de buscar en Google con un vídeo

En una extraña demostración en el escenario con un tocadiscos, Google mostró un nuevo truco de búsqueda muy impresionante. Ahora puedes grabar un vídeo y buscar en él para obtener resultados y, con suerte, una respuesta.

La persona encargada de la presentación se preguntaba cómo utilizar un tocadiscos; pulsó grabar para filmar la unidad en cuestión mientras preguntaba algo y luego la envió. Google hizo su magia de búsqueda y proporcionó una respuesta en texto, que podía leerse en voz alta. Es una forma totalmente nueva de buscar, como Google Lens para vídeo, y también muy diferente de la próxima IA cotidiana del Project Astra, ya que esta debe grabarse y luego buscarse, en lugar de funcionar en tiempo real.

Aun así, forma parte de una fusión de Gemini e IA generativa con la Búsqueda de Google, con el objetivo de mantenerte en esa página y facilitar la obtención de respuestas. Antes de esta demostración de búsqueda con vídeo, Google mostró una nueva experiencia generativa para recetas y restaurantes. Esto le permite buscar algo en lenguaje natural y obtener recetas o incluso recomendaciones de restaurantes en la página de resultados.

En pocas palabras, Google está apostando fuerte por la IA generativa en las búsquedas, tanto en los resultados como en las distintas formas de obtenerlos.

5. Google se enfrenta a Sora de OpenAI con su herramienta de vídeo Veo

Llevamos unos meses maravillándonos con las creaciones de Sora, la herramienta de conversión de texto a vídeo de OpenAI, y ahora Google se une a la fiesta del vídeo generativo con su nueva herramienta llamada Veo. Al igual que Sora, Veo puede generar vídeos de un minuto de duración en calidad 1080p, a partir de una simple instrucción.

Esa solicitud puede incluir efectos cinematográficos, como un time-lapse o una toma aérea, y las primeras muestras son impresionantes. Tampoco tienes que empezar desde cero: sube un vídeo de entrada con un comando y Veo editará el clip para que se ajuste a tu petición. También puedes añadir máscaras y modificar partes específicas de un vídeo.

¿Lo malo? Al igual que Sora, Veo aún no está disponible en todo el mundo. Google dice que estará disponible para creadores seleccionados a través de VideoFX, una de sus funciones experimentales de Labs, "en las próximas semanas". Podría pasar un tiempo hasta que veamos un despliegue amplio, pero Google ha prometido llevar la función a YouTube Shorts y otras aplicaciones. Y eso hará que Adobe se mueva inquieto en su silla generada por IA.

6. Android got a big Gemini infusion

Al igual que la función "Rodea para buscar" de Google se solapa encima de una aplicación, Gemini se integra ahora en el núcleo de Android para integrarse en tu día a día. Tal y como demostraron, Gemini ahora puede ver, leer y entender lo que hay en la pantalla de tu teléfono, permitiéndole anticipar preguntas sobre lo que estás viendo.

Así, puede obtener el contexto de un vídeo que estés viendo, anticiparse a una petición de resumen cuando veas un PDF largo o estar preparado para innumerables preguntas sobre una aplicación en la que estés. Contar con una IA consciente del contenido integrada en el sistema operativo de un móvil no está nada mal y podría resultar muy útil.

Además de la integración de Gemini en el sistema, "Gemini Nano con Multimodality" se lanzará a finales de este año en los dispositivos Pixel. ¿Qué hará? Bueno, debería acelerar las cosas, pero la característica principal, por ahora, es que Gemini escucha las llamadas y puede avisarte en tiempo real si se trata de spam. Eso está muy bien y se basa en el filtrado de llamadas, una característica de larga data de los teléfonos Pixel. Está preparado para ser más rápido y procesar más en el dispositivo en lugar de enviarlo a la nube.

7. Google Workspace será mucho más inteligente

Los usuarios de Workspace están recibiendo un tesoro de integraciones de Gemini y funciones útiles que podrían tener un gran impacto diario. Dentro del correo, gracias a un nuevo panel lateral a la izquierda, se puede pedir a Gemini que resuma todas las conversaciones recientes con otra persona. El resultado se resume con viñetas que destacan los aspectos más importantes.

Gemini en Google Meet puede ofrecerte los aspectos más destacados de una reunión o lo que podrían preguntar otras personas en la llamada. Ya no tendrías que tomar notas durante esa llamada, lo que podría resultar útil si es larga. Dentro de las Hojas de Cálculo de Google, Gemini puede ayudar a dar sentido a los datos y procesar peticiones como extraer una suma o un conjunto de datos específicos.

El compañero de equipo virtual "Chip" puede ser el ejemplo más futurista. Puede vivir en un G-chat y ser llamado para diversas tareas o consultas. Aunque estas herramientas llegarán a Workspace, probablemente primero a través de Labs, la pregunta que queda por responder es cuándo llegarán a los clientes habituales de Gmail y Drive. Teniendo en cuenta el enfoque de Google de la IA para todos y su fuerte impulso en las búsquedas, es probable que solo sea cuestión de tiempo.

Recomendado para ti:

Soy ingeniera informática y editora del equipo de TechRadar España. Me gusta todo tipo de tecnología, pero los ordenadores son mis dispositivos preferidos. Además de escribir sobre ellos me encanta arreglarlos, al fin y al cabo, pueden llegar a estar tan locos como yo.

- Mark WilsonSenior news editor

- Marc McLarenGlobal Editor in Chief

- Jacob KrolUS Managing Editor News

Más Populares