Apple, la privacy, le buone intenzioni e la strada per l'inferno

A lungo termine potrebbero esser introdotte misure che distruggeranno la privacy dell’utente

Dicono che la strada per l'inferno sia lastricata di buone intenzioni. Apple, forse, pensava che la sua idea di analizzare le fotografie su tutti gli iPhone, iPad e Mac fosse una buona idea, ma c'è chi ci vede un problema bello grosso.

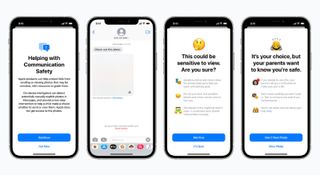

Si parla di nuove funzioni annunciate da poco e in arrivo con iOS 15. L'idea è che il dispositivo possa analizzare in totale autonomia, e senza avvisare, le immagini, alla ricerca di materiale pedopornografico. È prevista anche una funzione di controllo specifica per i genitori, che si applica ad iMessage.

Un dirigente di Whatsapp (che è un prodotto di Facebook, vedi alla voce ironia beffarda), lo ha addirittura definito un "sistema di sorveglianza". Insieme a lui, migliaia di esperti di privacy e sicurezza hanno firmato una lettera aperta per chiedere ad Apple di fare un passo indietro. Tra i firmatari anche Edward Snowden, che di sicuro sa una cosetta o due in tema di sorveglianza.

Al momento della stesura di questo articolo, oltre 5500 firmatari hanno preso parte alla petizione. "La proposta di Apple introduce una backdoor che minaccia di minare la privacy di tutti gli utenti dei prodotti Apple", è scritto nella lettera.

- Gli smartphone pieghevoli fanno gola anche a Apple, ecco perché

- Apple, i lavoratori preferiscono licenziarsi che tornare in ufficio

- iPhone 13, Apple punta ai 100 milioni di unità

Non solo per la privacy, c'è anche mancanza di responsabilità

Gli esperti hanno fatto notare che le soluzioni di Apple sono legate a un'infrastruttura espandibile che non può essere monitorata o tecnicamente limitata; hanno anche affermato che non si tratta solo di privacy, "ma anche di mancanza di responsabilità, barriere tecniche all'espansione e mancanza di analisi o persino riconoscimento del potenziale di errori e falsi positivi".

La tecnologia proposta da Apple funziona monitorando continuamente le foto salvate o condivise sull'iPhone, iPad o Mac dell'utente. Un sistema scansiona le foto e trasforma i dati in stringhe di codice, che vengono poi analizzati e confrontati con i database offerti dalle forze dell’ordine e comitati a protezione dei minori. Se c'è una corrispondenza con un'immagine nota, scatta un allarme.

Se viene riscontrato materiale potenzialmente pedopornografico, il sistema avvisa chi di dovere per un'ulteriore analisi e infine le autorità; vengono avvisati anche i genitori, se iMessage viene utilizzato per inviare o ricevere foto che contengono nudità.

Get daily insight, inspiration and deals in your inbox

Get the hottest deals available in your inbox plus news, reviews, opinion, analysis and more from the TechRadar team.

La lettera sostiene che: "i controlli vengono eseguiti sul dispositivo dell'utente, il che consente di aggirare qualsiasi crittografia end-to-end che altrimenti salverebbe la privacy di quest’ultimo". I firmatari hanno aggiunto anche che la tecnologia potrebbe essere usata per servire mezzi di sorveglianza più nefasti, un punto che anche Will Cathcart di WhatsApp ha affermato nel suo tweet.

I read the information Apple put out yesterday and I'm concerned. I think this is the wrong approach and a setback for people's privacy all over the world.People have asked if we'll adopt this system for WhatsApp. The answer is no.August 6, 2021

Diversi esperti e analisti del settore hanno dunque analizzato e commentato i difetti del nuovo programma di sicurezza di Apple e pare che i nuovi servizi vadano contro tutto quello per cui accademici, esperti e giornalisti hanno lottato per proteggere la privacy dell’utente.

La lettera avanza due proposte: uno, Apple deve fermare l'implementazione della tecnologia di monitoraggio dei contenuti, due, l’azienda deve rilasciare una dichiarazione che riaffermi il proprio impegno per la crittografia end-to-end. Per la cronaca, Apple ha affermato che le nuove funzionalità di sicurezza non rappresentano una backdoor per le sue funzionalità di privacy hardware e software.

La risposta di Apple

Apple distributed this internal memo this morning, dismissing their critics as "the screeching voices of the minority." I will never stop screeching about the importance of privacy, security, or civil liberties. And neither should you. pic.twitter.com/lLDfxEUIXLAugust 6, 2021

Come dicevamo in apertura, le buone intenzioni e la strada per l'inferno.

Apple sembra intenzionata a introdurre strumenti che possano proteggere bambini e bambine in tutto il mondo, con una soluzione tecnologica che in teoria può espandersi anche a persone che non usano un iPhone.

Non c'è ragione di credere che le intenzioni siano altre da quelle dichiarate. E però, allo stesso tempo, fa strano rilevare come Apple da una parte abbia per anni fatto campagne dicendo che la privacy su iPhone è meglio.

E poi, all'improvviso, ecco un vero e proprio sistema di sorveglianza.

When you boil it down, Apple has proposed your phone become black box that may occasionally file reports on you that may aggregate such that they contact the relevant authorities. It doesn't matter how or why they built that black box or even what the false positive rate may beAugust 6, 2021

Un sistema di sorveglianza, sì, ma che allo stesso tempo rispetta la privacy degli utenti? Sono più credibili gli unicorni

Un sistema di sorveglianza, sì, ma che allo stesso tempo rispetta la privacy degli utenti, si potrebbe pensare. Non può esistere nulla del genere, come vi confermerà chiunque lavori nel campo della crittografia e della sicurezza.

Apple sta inserendo una backdoor nei suoi dispositivi, e una volta che esiste non c'è modo di garantire che sarà usata solo per tutelare le buone intenzioni. È una cosa che abbiamo già visto altre volte - per esempio in tutti quei paesi autoritari che usano strumenti hi-tech per perseguire le minoranze. Strumenti che sono nati proprio per garantire le libertà care ai paesi democratici del mondo.

Eppure succede sempre, e pare davvero surreale che nessuno a Cupertino ci abbiamo pensato.

Apple sembra avere intavolato una collaborazione con il National Center for Missing and Exploited Children. Un'associazione benefica che descrive la crittografia end-to-end come un modo per nascondere gli abusi.

E sì, probabilmente è vero che la crittografia end-to-end ha aiutato più di un criminale a passarla liscia, da quando esiste. Ma è vero anche l'esatto contrario: la crittografia end-to-end è uno strumento di libertà individuale, e almeno in certi casi è garanzia di identità, libertà di espressione, persino incolumità fisica.

Apple infatti si aspettava le reazioni contrarie. E in un memo interno le ha definite "le gracchianti voci della minoranza".

Una definizione che ti aspetteresti nel discorso pubblico di un dittatore, non in un documento di una delle aziende più grandi del mondo. Una che fino a ieri ha fatto vangelo della privacy, delle libertà civili e della diversità.

Forse è stato un incidente, e qualcuno a Cupertino riprenderà presto le redini della situazione. O forse il vento sta cambiando in California?

- I migliori iPhone del 2021

Valerio Porcu è Redattore Capo e Project Manager di Techradar Italia. È da sempre ossessionato dai gadget e dagli oggetti tecnologici che cambiano la nostra vita quotidiana, e dai primi anni 2000 ha deciso di raccontarla. Oggi è un giornalista con anni di esperienza nel settore tecnologico, e ha ancora la voglia di trovare le chiavi di lettura giuste, per capire davvero in che modo la tecnologia può rendere migliore la nostra vita quotidiana.

Most Popular