YouTube podría contar en el futuro con un traductor en tiempo real

Google prueba un servicio de doblaje en tiempo real

Integrar a la perfección las capacidades de IA de PaLM 2 en todo el ecosistema de Google, incluido Bard, ha sido uno de los temas principales del evento Google I/O 2023. Aunque Google cree que hay algunas funciones que no deberían lanzarse al instante.

Durante la keynote de Google I/O, el vicepresidente senior de tecnología y sociedad de la compañía, James Manyika, planteó su preocupación por las posibles tensiones entre la desinformación y algunas capacidades de la IA, concretamente la tecnología que está detrás de las deep fakes.

A lo que se refiere es a los modelos lingüísticos que utilizan los deepfakes para doblar voces en los vídeos: ya sabes, esos en los que el monólogo de un actor famoso de una de las mejores series de televisión o de las mejores películas se cambia de repente por la sincronización labial.

Como resultado, Google está tomando algunas medidas para establecer lo que denomina "barandillas" con el fin de evitar el uso indebido de algunas de estas nuevas funciones dejando artefactos en fotos y vídeos, como marcas de agua y metadatos. Una nueva herramienta que será muy útil y beneficiosa, pero de la que fácilmente se podría hacer un mal uso, es un prototipo que Google está poniendo a disposición de un número determinado de socios, llamado "traductor universal".

El traductor universal de Google es un servicio experimental de doblaje de vídeo con IA que traduce el habla en tiempo real, lo que permite leer al instante lo que alguien dice en otro idioma mientras se ve un vídeo. El prototipo se presentó durante el evento, mostrando vídeos de una prueba que formaba parte de un curso universitario en línea creado en colaboración con la Universidad Estatal de Arizona.

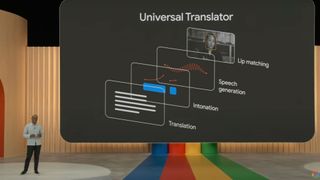

El modelo funciona en cuatro fases. En la primera, el modelo empareja los movimientos de los labios en un vídeo con las palabras que reconoce. En la segunda, un algoritmo genera el habla al instante.

La tercera etapa del modelo utiliza la entonación, que mide el aumento y la disminución del ritmo natural de alguien que habla, para ayudar a la traducción. Por último, una vez que ha reproducido el estilo y ajustado el tono a partir de los movimientos de los labios del hablante, lo reúne todo para generar la traducción.

Get the best Black Friday deals direct to your inbox, plus news, reviews, and more.

Sign up to be the first to know about unmissable Black Friday deals on top tech, plus get all your favorite TechRadar content.

Google afirma que los primeros resultados han sido prometedores. Los estudiantes universitarios del estudio muestran un mayor número de finalizaciones de los cursos.

¿Dónde estará el traductor universal?

Aunque la función de traductor universal aún no está disponible fuera de un pequeño grupo de pruebas beta, es posible que una vez que Google haya probado numerosas salvaguardas la extienda a servicios como YouTube y su servicio de videoconferencia Google Meet, por ejemplo.

Al fin y al cabo, poder traducir vídeos en directo en tiempo real a varios idiomas podría resultar una herramienta increíblemente útil. Un traductor universal no solo aumentaría la audiencia global de un canal de YouTube, sino que permitiría más proyectos de colaboración entre países.

Estaremos atentos para conocer más detalles sobre esta función y sus posibles aplicaciones en el ecosistema de Google.

Alexa Hernandez es amante de los animales, series, películas y tecnología.

- Amelia SchwankeSenior Editor UK, Home Entertainment